Vous avez lu "LLM" dix fois cette semaine sans vraiment savoir ce que ça signifie. Pas de panique : en 3 minutes, vous allez comprendre ce qui se cache derrière ces trois lettres qui transforment tous les métiers.

LLM : définition simple d'un Large Language Model

Un LLM, pour Large Language Model, est un programme d'intelligence artificielle entraîné pour comprendre et générer du texte. En français, on parle de grands modèles de langage. Concrètement, un LLM est capable de lire une question, d'en saisir le sens, et de formuler une réponse cohérente. Exactement comme un humain le ferait. Sauf qu'il le fait en quelques secondes et à grande échelle.

Ces modèles de langage reposent sur le deep learning, une branche avancée de l'apprentissage automatique. Ils ont été entraînés sur des milliards de pages de texte : livres, articles, sites web, forums, documentation technique. Le résultat ? Un système capable de génération de texte, d'analyse de texte, de traduction automatique, de résumé, et de bien d'autres tâches liées au traitement du langage naturel.

Le traitement du langage naturel, ou NLP (Natural Language Processing), est le domaine de l'intelligence artificielle qui s'occupe de faire comprendre le langage humain aux machines. Les LLM en sont la dernière génération. Ils n'ont pas été programmés avec des règles grammaticales manuelles. Ils ont appris à écrire en observant des quantités colossales de texte. C'est ce qui les rend si polyvalents et si bluffants.

À retenir : un LLM est un large language model, c'est-à-dire un grand modèle de langage basé sur le deep learning. Il est capable de comprendre, analyser et générer du texte dans pratiquement n'importe quel contexte.

Comment fonctionne un LLM ? Explication sans jargon

Comprendre le fonctionnement d'un LLM ne demande pas un doctorat en informatique. Il suffit de saisir trois briques fondamentales : l'architecture qui le fait tourner, la façon dont il découpe le texte, et la méthode d'entraînement qui le rend performant.

L'architecture Transformer : le moteur des LLM

Tout commence en 2017, quand des chercheurs de Google publient un article devenu légendaire : "Attention is All You Need". Ils y présentent l'architecture transformer, un nouveau type de réseau de neurones conçu spécifiquement pour le traitement du langage naturel.

Avant les transformers, les modèles de langage lisaient le texte mot par mot, dans l'ordre. C'était lent et peu efficace pour comprendre le contexte d'une phrase longue. L'architecture transformer a changé la donne grâce à un concept clé : le mécanisme d'attention.

Le mécanisme d'attention permet au modèle d'analyser tous les mots d'une phrase en parallèle. Mieux encore, grâce à l'auto-attention, chaque mot "regarde" tous les autres mots pour comprendre son propre rôle dans la phrase. Prenez la phrase "La banque du fleuve était escarpée". Le mot "banque" n'a pas le même sens que dans "J'ai ouvert un compte en banque". C'est l'auto-attention qui permet au modèle de faire cette distinction en analysant les mots autour.

Cette capacité a révolutionné le NLP. Tous les grands modèles de langage actuels, qu'il s'agisse de GPT, Claude, Gemini ou Mistral, reposent sur cette architecture transformer. Sans elle, aucun des outils d'intelligence artificielle que vous utilisez aujourd'hui n'existerait sous cette forme.

Tokenisation, pré-entraînement et fine-tuning : les trois étapes clés

Un LLM ne lit pas des mots. Il lit des tokens. La tokenisation est le processus qui découpe le texte brut en petites unités que le modèle peut traiter. Par exemple, le mot "incroyablement" pourrait être découpé en "incroyable" et "ment". Cette étape est essentielle : elle détermine la façon dont le modèle comprend et produit du texte.

Une fois la tokenisation en place, l'entraînement d'un LLM se fait en plusieurs phases. Voici les trois principales :

- Pré-entraînement : le modèle ingère des volumes massifs de données d'entraînement. Il apprend à prédire le mot suivant dans une phrase, encore et encore, sur des milliards d'exemples. C'est la phase la plus coûteuse en calcul. Elle donne au LLM sa culture générale et sa maîtrise de la langue. L'apprentissage automatique fait le gros du travail ici.

- Fine-tuning : une fois le pré-entraînement terminé, on affine le modèle sur des données plus spécifiques. On peut, par exemple, spécialiser un LLM dans la génération de code, dans le domaine juridique ou dans le service client. Le fine-tuning rend le modèle plus précis pour un usage donné sans repartir de zéro.

- Alignement humain : c'est l'étape la plus récente et la plus stratégique. Grâce à une technique appelée RLHF (Reinforcement Learning from Human Feedback), des humains évaluent les réponses du modèle et lui apprennent à être plus utile, plus honnête et moins dangereux. L'alignement humain est ce qui fait la différence entre un LLM brut et un assistant fiable comme ceux qu'on utilise en entreprise.

Chacune de ces étapes repose sur d'énormes volumes de données d'entraînement. La qualité et la diversité de ces données ont un impact direct sur les performances du modèle final.

À quoi servent les LLM ? Les cas d'utilisation

On parle beaucoup de théorie. Mais ce qui intéresse la plupart des professionnels, c'est l'usage réel. Alors, concrètement, quels sont les cas d'utilisation des LLM aujourd'hui ?

Les chatbots et les agents conversationnels sont l'application la plus visible. Des millions de personnes discutent chaque jour avec ChatGPT, Claude ou Gemini pour obtenir des réponses, rédiger des emails, préparer des réunions ou explorer des idées. En entreprise, les agents conversationnels prennent en charge le support client, la qualification de leads et même l'onboarding des nouveaux collaborateurs.

La génération de texte est un autre terrain massif. Les LLM rédigent des articles, des briefs marketing, des posts LinkedIn, des descriptifs produit, des comptes rendus de réunion. Un responsable marketing qui passait une demi-journée à écrire une newsletter peut désormais produire un premier jet en quelques minutes. La qualité n'est pas toujours parfaite du premier coup, mais le gain de productivité est réel.

La génération de code transforme le quotidien des développeurs. Des outils comme GitHub Copilot, alimentés par des LLM, suggèrent du code en temps réel, détectent des bugs et proposent du refactoring. Même des profils non techniques commencent à créer des scripts et des automatisations grâce aux grands modèles de langage.

La traduction automatique a fait un bond spectaculaire. Les LLM ne traduisent plus mot à mot. Ils comprennent le contexte, les nuances culturelles et le registre de langue. C'est un atout énorme pour les entreprises qui opèrent à l'international et qui ont besoin de localisation rapide et fiable.

L'analyse de texte permet d'extraire des insights à partir de grandes quantités de documents. Contrats juridiques, retours clients, rapports financiers, enquêtes internes : les LLM savent résumer, classer, identifier des tendances et sortir l'essentiel de milliers de pages en quelques secondes.

Et ce ne sont que les usages les plus courants. On voit aussi des cas d'utilisation des LLM dans la recherche scientifique, la création de contenu pédagogique, l'automatisation de tâches RH, la veille concurrentielle et la synthèse d'information stratégique.

LLM open-source vs modèles propriétaires : le paysage actuel

Quand on parle de LLM, deux grandes familles se distinguent. D'un côté, les modèles propriétaires. De l'autre, les LLM open-source. Comprendre cette distinction est essentiel pour faire un choix éclairé.

Les modèles propriétaires qui dominent le marché

GPT d'OpenAI sont les plus connus. Ils alimentent ChatGPT et des milliers d'applications via API. Claude, développé par Anthropic, se distingue par sa fiabilité et sa capacité à traiter des documents longs. Gemini, de Google DeepMind, mise sur l'intégration dans l'écosystème Google. Ces modèles propriétaires offrent des performances de pointe. Mais ils impliquent un coût d'utilisation, une dépendance à un fournisseur et une opacité sur les données d'entraînement utilisées.

Les LLM open-source qui montent en puissance

Face aux géants, une alternative se structure. LLaMA de Meta, Mistral de la startup française Mistral AI, ou encore Falcon et Qwen proposent des modèles de langage ouverts, gratuits et modifiables. L'intérêt du LLM open-source est triple : transparence totale sur le fonctionnement du modèle, possibilité de fine-tuning sur ses propres données, et souveraineté des données puisque tout peut tourner sur ses propres serveurs.

Pour choisir entre LLM open-source et modèles propriétaires, quatre critères comptent. Le coût d'abord : les modèles propriétaires facturent à l'usage, les LLM open-source demandent de l'infrastructure. La personnalisation ensuite : le fine-tuning est beaucoup plus accessible avec l'open-source. La performance brute : les modèles propriétaires gardent souvent une avance, même si l'écart se réduit vite. Et enfin la confidentialité : si vos données sont sensibles, un LLM open-source déployé en interne est souvent plus prudent.

Avantages et limites des LLM : ce qu'il faut savoir avant de se lancer

Aucune technologie n'est parfaite. Les grands modèles de langage ne font pas exception. Avoir une vision claire des avantages des LLM et de leurs limites est indispensable pour les utiliser intelligemment.

Ce que les LLM font remarquablement bien

Le premier avantage des LLM, c'est le gain de productivité. Toute tâche qui implique de la génération de texte, de l'analyse de texte ou de la synthèse d'information se fait désormais en une fraction du temps. Un juriste qui analyse un contrat de 80 pages, un marketeur qui rédige 10 variantes d'un email, un développeur qui débogue une fonction complexe : tous gagnent des heures chaque semaine.

La polyvalence est un autre atout majeur. Un seul LLM peut gérer des dizaines de tâches NLP différentes sans avoir besoin d'un modèle spécialisé pour chacune. Génération de texte, traduction automatique, classification, extraction d'entités, résumé, génération de code : tout passe par le même système.

L'accessibilité progresse aussi vite que la technologie. Les API sont simples à intégrer, les interfaces no-code se multiplient, et les LLM open-source permettent à des équipes modestes de déployer des solutions d'intelligence artificielle sans budget astronomique. Le fine-tuning rend ces modèles adaptables à presque tous les secteurs et tous les métiers.

Hallucinations IA, biais et autres zones d'ombre

Parlons des choses qui fâchent. Les hallucinations IA sont le talon d'Achille des LLM. Il arrive qu'un grand modèle de langage invente des faits, cite des sources inexistantes ou donne une réponse totalement fausse avec un aplomb déconcertant. Ce n'est pas un bug ponctuel. C'est une caractéristique structurelle de la façon dont ces modèles génèrent du texte. Ils prédisent des séquences probables, pas des vérités. Vérifier les sorties d'un LLM reste donc indispensable, surtout dans des contextes à fort enjeu.

Les biais des LLM sont un autre sujet critique. Les données d'entraînement contiennent inévitablement des biais : sociaux, culturels, de genre, géographiques. Le modèle les absorbe et les reproduit dans ses réponses. L'alignement humain réduit le problème, mais ne l'élimine pas complètement. Les biais des LLM sont un chantier permanent pour tous les laboratoires d'intelligence artificielle.

Il y a aussi le coût énergétique et environnemental. Entraîner un LLM consomme une quantité massive d'énergie et d'eau. Les limites des LLM ne sont pas que techniques : elles sont aussi écologiques et éthiques. Et enfin, l'opacité : personne ne sait vraiment pourquoi un LLM produit telle réponse plutôt qu'une autre. Ce problème de "boîte noire" pose des questions sérieuses en matière de responsabilité, notamment dans la santé, la justice ou la finance.

Ce que les LLM vont changer dans les 12 prochains mois

On est encore au début. Aussi impressionnants que soient les grands modèles de langage aujourd'hui, ce qui arrive va accélérer les choses.

La première tendance forte, c'est l'émergence des agents IA autonomes. Aujourd'hui, les chatbots répondent à des questions. Demain, les agents conversationnels vont enchaîner des tâches complexes de manière autonome. Prendre un brief, rechercher des données, rédiger un rapport, l'envoyer par email et planifier un suivi. Sans intervention humaine entre chaque étape. On passe du modèle de langage passif à l'intelligence artificielle active.

La spécialisation des modèles de langage par secteur va aussi s'accélérer. On voit déjà apparaître des LLM taillés pour la santé, le juridique, la finance ou l'éducation. Le fine-tuning sur des données métier spécifiques produit des résultats bien supérieurs à ceux d'un modèle généraliste. Cette tendance va rendre les grands modèles de langage accessibles et pertinents pour des entreprises qui pensaient que l'intelligence artificielle n'était pas pour elles.

La démocratisation du fine-tuning pour les PME est un autre mouvement de fond. Jusqu'à récemment, affiner un LLM exigeait des compétences rares et des budgets importants. Les outils se simplifient. Les coûts baissent. Des entreprises de 20 personnes vont pouvoir déployer un modèle de langage spécialisé sur leurs propres données, hébergé sur leur infrastructure, sans dépendre d'un acteur américain ou chinois.

L'enjeu de l'alignement humain va aussi prendre de l'ampleur avec la régulation. L'AI Act européen entre progressivement en application. Il impose des standards de transparence, de sécurité et de responsabilité aux fournisseurs de modèles d'intelligence artificielle. Les entreprises qui intègrent des LLM dans leurs process devront pouvoir justifier la fiabilité de leurs systèmes. L'alignement humain passe du nice-to-have au must-have.

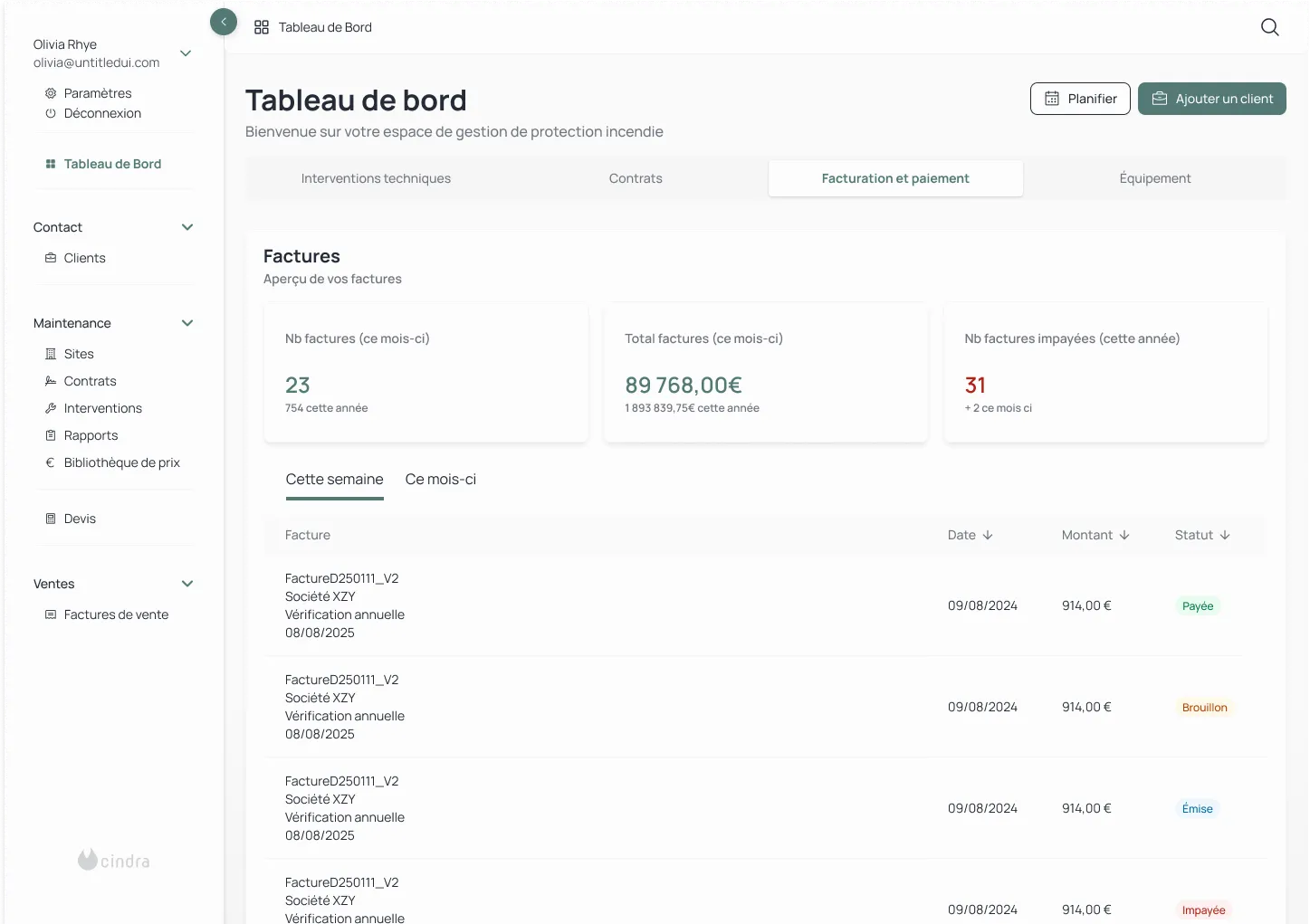

Enfin, la convergence entre LLM et outils métiers va transformer les flux de travail. Les CRM, les ERP, les outils marketing, les plateformes de gestion de projet vont embarquer nativement des modèles de langage. On ne parlera plus d'utiliser un chatbot à côté de son outil. Le modèle sera dans l'outil, invisible et performant.

Et maintenant, comment passer à l'action ?

Vous savez désormais ce qu'est un LLM, comment il fonctionne, à quoi il sert et quelles sont ses forces comme ses limites. La vraie question n'est plus "qu'est-ce qu'un large language model", mais "comment je l'intègre dans mon activité pour en tirer un avantage concret".

C'est exactement ce qu'on fait chez Scroll. On accompagne les entreprises dans l'intégration opérationnelle de l'intelligence artificielle : audit des cas d'usage, choix du bon modèle de langage, déploiement, formation des équipes. Pas de slides, pas de promesses vagues. Du concret, du sur-mesure, et des résultats mesurables.

Vous voulez savoir ce qu'un LLM peut faire pour votre entreprise ? Parlons-en.

LLM signifie Large Language Model, ou grand modèle de langage en français. C'est un programme d'intelligence artificielle entraîné sur des milliards de textes grâce au deep learning. Un LLM est capable de comprendre, analyser et générer du texte de manière autonome. Il repose sur l'architecture transformer et le mécanisme d'attention pour saisir le sens et le contexte du langage humain.

Un modèle propriétaire comme GPT ou Claude est développé et hébergé par une entreprise. L'accès se fait via API, contre un coût d'utilisation. Un LLM open-source comme LLaMA ou Mistral est gratuit, modifiable et peut être déployé sur vos propres serveurs. Le choix dépend de vos besoins en personnalisation, en confidentialité des données et de votre budget infrastructure.

Les cas d'utilisation des LLM les plus courants sont les chatbots et agents conversationnels pour le support client, la génération de texte pour le marketing, la génération de code pour les équipes techniques, la traduction automatique pour l'international et l'analyse de texte pour extraire des insights de documents volumineux. Le fine-tuning permet aussi de spécialiser un LLM sur un métier précis.

Oui. Les hallucinations IA sont une limite connue des grands modèles de langage. Un LLM peut produire des informations fausses ou inventer des sources avec une apparence de certitude totale. Il ne vérifie pas les faits : il prédit des séquences de mots probables. Les biais des LLM, hérités des données d'entraînement, peuvent aussi fausser les réponses. Une vérification humaine reste indispensable dans tout contexte à fort enjeu.

L'entraînement d'un LLM se déroule en trois étapes. Le pré-entraînement expose le modèle à des volumes massifs de données d'entraînement pour qu'il apprenne la structure du langage grâce à l'apprentissage automatique. Le fine-tuning affine ensuite ses compétences sur des tâches ou des domaines spécifiques. Enfin, l'alignement humain utilise les retours d'évaluateurs pour rendre le modèle plus fiable, plus utile et moins biaisé. La tokenisation intervient en amont pour découper le texte en unités exploitables par le modèle.

.svg)

.svg)

.svg)

.svg)